摘要

如今智能会议管理受到人们的广泛关注。现有的大多数智能系统只关注小型会议室中的谈话记录,而本文介绍了一种大礼堂智能会议管理系统。系统中嵌入了级联空座检测算法,以获取每个座位的状态。根据遮挡的程度逐级标示空位情况。结合预先输入的与会者信息,系统可以在会议期间为人们提供就座情况和相应的与会者信息。实验结果表明,座椅状态检测精度可达99.8%。

类别和主题描述符

H.4[图像处理与计算机视觉]:杂项

关键字

智能会议,视频分析,座位检测

1 前言

会议是以交流和交换信息为目的的最常见的活动之一。因而会议的智能化管理对于提高会议管理的效率,营造安全的会议环境具有非常重大的意义。会议智能管理系统旨在了解会议室中发生了什么、正在发生什么以及将要发生什么。因此,基于物体检测跟踪、行为识别等的视频分析在智能会议管理中扮演着非常重要的角色。

到目前为止,已经有许多智能会议相关的概念, [1, 2, 3, 4]. 其中有许多都借助视频分析来理解其情境中的内容。检测和跟踪的方法是用来分析与会者的行为[5,6],以了解在会议室里发生了什么。然而,在一个大礼堂里,人们总是在整个会议过程中坐在自己的座位上。 很少有互动发生。在室内环境中,遮挡和阴影是检测和跟踪的两个主要问题。 为了解决这个问题,之前的一些作品使用了对阴影和照明等变化不敏感的3D信息[7,8]。此外,基于3D的方法需要强大的硬件支持,尤其是在参会者众多的情况下,使得这些方法很难满足实时性的要求。除了3D方法,Dai等人[9]利用运动、颜色、梯度、原始灰度特征作为视觉线索,形成一个增强级联[10]以供人物检测。他们认为运动是人类存在的重要线索,这使得运动对光照变化和其他干扰非常敏感。在[3]中,人脸检测直接参与其中。然而,由于人脸识别在这一过程中是必要的,因此人脸的角度至关重要。虽然这个问题可以通过建立包含一定角度的训练人脸数据库来解决,但是在会议中仍然需要估计人脸的朝向。

然而,这些系统更多的关注的是人们在会议过程中的互动,然而这里仍存在很多局限。例如,[1]要求会议室较小,系统可以通过高质量的图像捕捉到参与者行为的细节; [2]参加者人数应足够少,以使系统免受严重的干扰和阻塞;[3]到场人员流动性低是保证系统有效性的必要条件; [4]这些系统强调对个人的分析,应该安装大量的摄像头,以确保每个人都有一个良好的视野在全领域。因此,它们只适用于人数不超过10人的小型会议室。

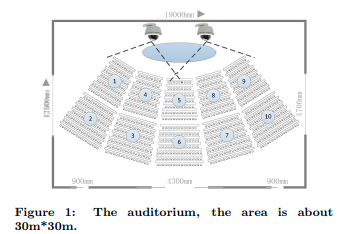

在如图1所示的可以容纳数千人的大礼堂中,记录参与者的状态比记录他们的互动更重要。在如图1所示的可以容纳数千人的大礼堂中,记录参与者的状态比记录他们的互动更重要。本文关注的是大礼堂的整体情况,而不是个人的行为。礼堂的情况可以通过会议期间的人的存在来反映。考虑到座位与参会者之间的一致性,该问题可视为座位检测问题。了解参会者在座位上的状态是一种直接控制和预测会议进展的方法。这将有助于人们在会议管理方面采取适当的行动。

在大礼堂中,座椅检测任务存在许多具体问题。第一个问题是在礼堂面积大,人数多的情况下,如何在图像分辨率和摄像机数量之间保持良好的平衡。其次,座椅检测容易产生严重的噪声。座椅的特点应该是对光照变化、人影和光点有较强的鲁棒性。第三,外部干扰对座椅检测结果造成很大的干扰。针对上述问题,本文提出了一些解决方案。视频捕捉设备是PTZ摄像机,可以在多个预设之间切换。针对严重的噪声问题,提出了一种三步走检测算法。最后,有一个校准过程来处理所有座椅信息的统计,这个过程可以纠正由于座椅情况临时变化而导致的错误结果。

本文主要为构建智能会议提供两种支持:1)在大型礼堂中使用PTZ摄像机采集图像;2)提出了一种处理遮挡的座椅检测的三步检测方法。论文的提纲如下。第2节首先对座椅检测算法进行了详细介绍。第3节给出了在实际礼堂中的实验结果和应用,验证了所提出的座椅检测算法的有效性。最后对工作进行了总结,并对今后的工作进行了展望。

2 座位检测

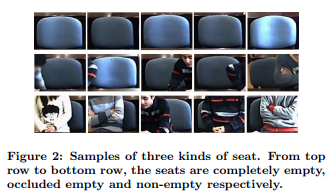

本节将详细介绍座椅检测算法。座位检测的任务可以描述为座位是否有人坐的问题。然而,在会议期间,一些座位会被严重的噪音所堵塞,比如包或衣服。在这种情况下,很难发现他们是空座位。针对这一问题,提出了一种三步检测方法。它是建立在一个推进级联的基础上的。其基本思想是,座椅的外观根据遮挡的级别和位置变化很大。事实上,所有的空座在颜色、形状和质地上都表现出高度的一致性。虽然空座位易发生遮挡,但遮挡往往发生在座位侧面,而遮挡的空座位顶部仍保持原有特征。一旦一个座位被与会者占据,这个座位几乎失去了图像中所有的原始外观。因此,我们将座椅分为三种类型:完全空的、遮挡空的和非空的,如图2所示。

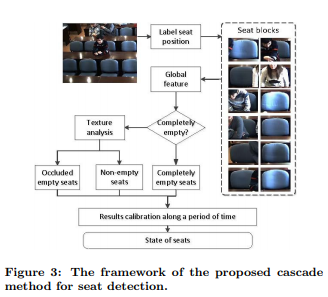

这三个步骤分别是粗检索过程、细检索过程和结果校准。图3所示为提出的回收空座位的升压级联结构。由于外观一致性高,首先对完全空的座椅进行检索,加快了整个过程的速度,这是一个粗糙的检索过程。在此基础上,对闭塞的空座和非空座进行了具有良好特性的分析,以保证系统的精度。这是一个很好的检索过程。

2.1 粗检索过程

粗检索过程的目的是区分完全空的座位、封闭的空的座位和非空的座位。考虑到所有的空位在外观上具有高度的一致性,当一个空位被占据时,其外观变化很大。因此,背景和前景之间的减法迅速增加,可以用来获得座椅的状态。首先建立背景模型。为简单起见,礼堂中没有人时拍摄的视频可以用作背景模型。前景区域是直接获得的实时视频。然后使用背景减法。为了对光照变化具有一定的鲁棒性,在HSV颜色空间和梯度图中实现了背景减法。每个座椅的特点可以描述为:

$$ f^hsv_i = ∥f^hsv_bg − f^hsv_fg ∥_1 $$

$ f^grd_i = ∥f^grd_bg − f^grd_fg ∥_1 $ (1)

最终座位状态 $ S_i $ 通过下式获得:

$$ S_i = \begin{cases} 0, & \text {if $f^hsv_i + f^grd_i$ > θ} \ 1, & \text{else} \end{cases} $$ (2)

这里$θ$是状态$ S_i $的阈值

2.2 细检索过程

精细检索过程的目的是区分被遮挡的空座位和非空座位。这是通过对座椅的精细纹理和轮廓分析来实现的。

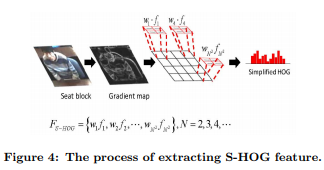

HOG特征在很多应用中都被证明是有效的,比如对象检测。考虑到座位被人遮挡和占据时遮挡位置的不同,提出了简化HOG特征(S-HOG)[11]。提取S-HOG的过程如图4所示。

首先计算每个座块的梯度图,然后将其划分为8*8像素的单元格。在提取HOG特征的过程中,计算每个单元的梯度方向直方图。座块的每个单元表示座位的不同部分。当座椅被人或衣服遮挡时,座椅外观的轮廓会发生变化。根据人体姿势的一致性,座椅的一些单元容易被遮挡,而另一些单元则不会。因此,给每个单元分配一个权重来表示遮挡对座椅状态识别的影响。通过提取所有单元的HOG特征,对遮挡的空座和非空座进行分类。不同的单元分类器的精度不同,反映的是遮挡不同位置对结果的影响不同,这也被成为单元的权重。因此S-HOG特征可以被描述为:

$ f_S-HOG = {w_1f_1, w_2f_2, · · · , w_{M∗N} f_{M∗N} } $ (3)

其中$M$、$N$为$x$、$y$方向的单元数,$f_i$为单元的HOG特征,$w_i$为细胞平均权重。

默认情况下,我们使用线性SVM来训练分类器进行检测。

2.3 按时间结果校准

通过从粗到细的空座位检索过程,礼堂中的每个座位都分配了一个标签来表示其状态。但是,由于外部干扰,可能会有一些误差。这些错误是由一些暂时的干扰造成的。例如,人们走过空的座位或经过空的座位。因此,结果校准的目的是纠正座椅的临时错误判断。本文采用一段时间内检测结果的中值滤波进行校正。

3 实验结果与应用

3.1 PTZ摄像头设置

考虑到礼堂可容纳数千人,场地面积大,摄像机设置应保证礼堂内所有座位都被遮挡住,所拍摄的图像分辨率高,而使用的摄像机越少越好。工作的(12、13、14),他们采用全方位摄像机可以覆盖360◦实现高覆盖率。这个方案的问题是,随着座椅和相机之间距离的增加,遮挡会变得更加严重。这给座椅检测工作带来了困难。

一般来说,避免遮挡的最佳拍摄角度是安装在座椅上方。只要相机与座椅之间的距离足够长,座椅的变形和遮挡问题就可以忽略。我们将礼堂分成几个区域,然后为每个PTZ摄像机设置5-6个预设,如图1所示。每个预设值负责一个区域。

3.2 座椅检测结果

座位检测算法适用于可容纳上千人的大型礼堂。从两个会议区域提取的座位块作为训练集,其中包含1982个空座位块和2946个非空座位块。将另一次约1小时的会议视频作为测试集,从该数据集中采集77幅经典图像。对礼堂内随机区域的地面真值进行了标定,验证了算法的有效性。区域覆盖64个座位,每个座位块平均为80 * 100像素。

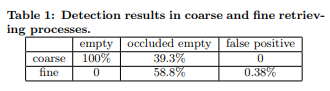

本文采用空座位召回率来评价所提出的检测算法。考虑到粗检索过程和细检索过程针对不同类型的空座位进行检索,分别得到了完全空座位和遮挡空座位的查全率。在77*64=4928个座块中,有1259个为完全空座,735个为封闭空座,2934个为非空座。座椅检测结果如表1所示。

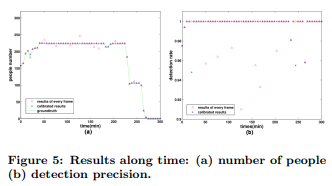

粗检索过程的目的是检索完全空的座位。在此过程中,在HSV颜色空间中实现背景减法,以保证特征对光照变化具有鲁棒性。对于与座椅颜色相同的一些人,使用梯度图的背景减法来捕捉座椅块轮廓的变化。因此,粗检索过程可以回忆起几乎所有完全空的位置,如表1所示。对于剩余座椅,采用精细回收工艺。召回被封闭的空座位的结果也令人满意。针对这两种方法误差较小的情况,采用标定模块对扰动进行滤波。实验结果表明,在标定前,阀座检测精度达到99.73%,标定后,阀座检测精度达到99.87%。系统的最终结果如图5 (a)和(b)所示。

3.3 座椅检测的应用

构建了一种基于座位检测的智能会议系统。该系统结合参会人员信息的提前输入,为参会人员提供会议期间大礼堂的整体情况。该系统在信息自动显示和快速查询两方面满足了人们对智能管理的要求。由于礼堂的管理涉及到所有参会者的管理,所以既要考虑到礼堂的整体情况,又要考虑到每个座位的细节。

3.3.1 大礼堂的整体情况

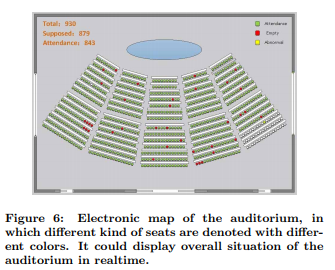

为了覆盖大礼堂,系统使用多个PTZ摄像机对大礼堂内的每个区域进行扫描。然后我们把各个区域组合在一起,得到礼堂的整体情况。如图6所示,电子分布图作为全局描述形成。在电子分布图中,礼堂的每个座位都被描述成一个长方形,座位的状态用不同的颜色表示。一旦座位被新入座者或缺席者占据,相应座位的颜色就会发生变化,从而直接反映出礼堂的整体情况。

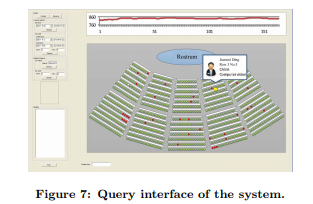

随着时间的推移,电子分布图的历史数据被保存下来。任何时候的电子分布图都可以查询。同时,为了方便查找全局的变化,形成了一段时间内的统计量。查询特定的座位或与会者可以快速定位到礼堂的准确位置,如图7所示。

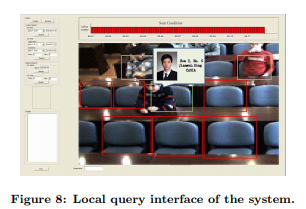

3.3.2 大礼堂的局部情况

局部情况展示是查看礼堂区域的详细信息,如图8所示。视图中的每个参与者的信息都可以被获取,包括姓名、公司、出席时间等。每个与会者和每个座位的当前历史保存为表单

统计数据。

4 总结

本文提出了一种以座位状态为核心的实时智能会议管理系统,避免了其他行为分析系统的不足。采用PTZ摄像机代替传统摄像机,可以以更低的成本覆盖整个礼堂。在检测中,通过一种由粗到细的空座椅检索方法,可以准确地获取各个座椅的状态,不受遮挡和严重噪声的干扰。结合座位和参会者的不同,系统可以为用户提供整个会议期间的每个座位和每个参会者的情况。在实际会议上的实验结果验证了所提出的座椅检测系统的有效性。

5 致谢

本课题由国家基础研究计划(批准号:2012cb316302)、国家重点技术研发计划(批准号:2012bah07b01)、国家自然科学基金(61105009)资助。

6 参考文献

[1] Z. Yu and Y. Nakamura, “Smart meeting systems: A survey of state-of-the-art and open issues,” ACM Computing Surveys (CSUR), vol. 42, no. 2, p. 8, 2010.

[2] M. Bett, R. Gross, H. Yu, X. Zhu, Y. Pan, J. Yang, and A. Waibel, “Multimodal meeting tracker,” in Proceedings of RIAO, 2000.

[3] I. Mikic, K. Huang, and M. Trivedi, “Activity monitoring and summarization for an intelligent meeting room,” in Human Motion, 2000. Proceedings. Workshop on, pp. 107–112, IEEE, 2000.

[4] D.-S. Lee, B. Erol, J. Graham, J. J. Hull, and N. Murata, “Portable meeting recorder,” in Proceedings of the tenth ACM international conference on Multimedia, pp. 493–502, ACM, 2002.

[5] P. Dai, L. Tao, and G. Xu, “Audio-visual fused online context analysis toward smart meeting room,” in Ubiquitous Intelligence and Computing, pp. 868–877, Springer, 2007.

[6] K. S. Huang and M. M. Trivedi, “Video arrays for real-time tracking of person, head, and face in an intelligent room,” Machine vision and applications, vol. 14, no. 2, pp. 103–111, 2003.

[7] T. Svoboda, H. Hug, and L. Van Gool, “Viroom , a llow cost synchronized multicamera system and its self-calibration,” in Pattern Recognition, pp. 515–522, Springer, 2002.

[8] J. Krumm, S. Harris, B. Meyers, B. Brumitt, M. Hale, and S. Shafer, “Multi-camera multi-person tracking for easyliving,” in Visual Surveillance, 2000. Proceedings. Third IEEE International Workshop on, pp. 3–10, IEEE, 2000.

[9] P. Dai, L. Tao, and G. Xu, “Dynamic context driven human detection and tracking in meeting scenarios,” in Proc. 2nd Intl. Conf. on Computer Vision Theory and Applications, 2007.

[10] P. Viola and M. Jones, “Rapid object detection usinga boosted cascade of simple features,” in Computer Vision and Pattern Recognition, 2001. CVPR 2001. Proceedings of the 2001 IEEE Computer Society Conference on, vol. 1, pp. I–511, IEEE, 2001.

[11] H. Liang, J. Wu, and K. Huang, “People in seats counting via seat detection for meeting surveillance,” in Pattern Recognition, pp. 202–210, Springer, 2012.

[12] Z. Yu, M. Ozeki, Y. Fujii, and Y. Nakamura, “Towards smart meeting: enabling technologies and a real-world application,” in Proceedings of the 9th international conference on Multimodal interfaces, pp. 86–93, ACM, 2007.

[13] J. S. Garofolo, C. D. Laprun, M. Michel, V. M.Stanford, and E. Tabassi, “The nist meeting room pilot corpus,” in Proc. of Language Resource and Evaluation Conference, 2004.

[14] C. Busso, S. Hernanz, C.-W. Chu, S.-i. Kwon, S. Lee, P. G. Georgiou, I. Cohen, and S. Narayanan, “Smart room: participant and speaker localization and identification,” in Acoustics, Speech, and Signal Processing, 2005. Proceedings.(ICASSP’05). IEEE International Conference on, vol. 2, pp. ii–1117, IEEE, 2005.

原文链接

笔记

座位检测 seat-detection

实时性 real-time

本博客所有文章除特别声明外,均采用 CC BY-SA 3.0协议 。转载请注明出处!